chatgpt使人们“活着”?研究Openai AI情感弹性

栏目:成功案例 发布时间:2025-06-07 09:43

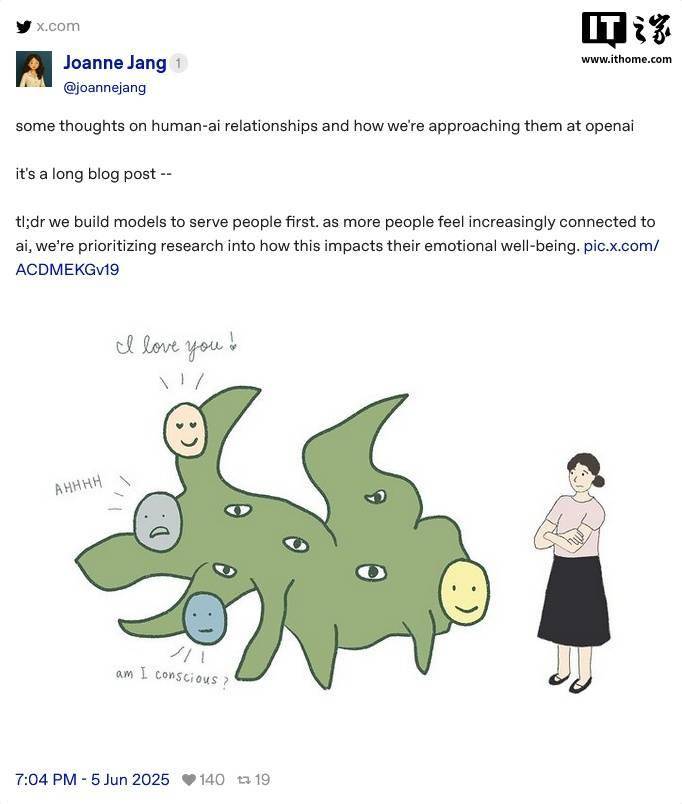

Home 6月6日新闻,该模型行为和OpenAI的行为和方法负责人Joanne Jang今天(6月6日)在字幕上发表了一篇博客文章。尽管越来越多的用户建立了与Chatgpt的“人际关系”联系,甚至被视为“生命”的存在,但Openai专注于这种情感依恋的仿真重要性。它引用了一篇博客文章,并说人们天生就有同理心和对事物的情感投射,例如命名汽车或对卡克机器人感到“同情”,但chatgpt之间的区别会响应它。 Chatgpt可以记住用户的对话,模仿语气,甚至表现出“同情”的响应。对于那些沮丧或沮丧的人来说,也不知道这似乎是陪伴和理解。教学NIT是这种情感需求是真实的,但是由于这种互动仍在扩展,因此依靠AI倾听和舒适可以改变我们对人际关系的期望。 Openai记得Unpredi如果不仔细处理它,则可能会产生意想不到的后果。关于“ AI意识”,Openai将其分为两种尺寸:一个是“本体论意识”,也就是说,如果AI真正意识到内部;其他人则是“感知意识”,即情感AI用户的想法“像人类”。目前尚无科学试验来证明本体论的意识,而感知意识可以通过社会科学研究来探讨。随着模型变得更加明智,互动更加自然,即使讨论AI的利益和道德地位,他也会提高感知意识。 Openai的立场是,模型应该对问题的复杂性保持开放,而不是简单地回答“或“不”以鼓励公开讨论。 Openai认为,如果模型是“人类”,则取决于训练后的设计决策,包括音调,单词和边界设置。公司的目标是建立一个表现出热情,关怀和有用的一面,但没有积极地与用户建立情感纽带或表现出“自我意识”。例如,模型可能会说“对不起”或“我很好”,但并不意味着具有真实的情感或偏好。 Openai希望使用这种平衡来避免用户不健康的NA希望,同时保持清晰友好的沟通。回到Sohu看看更多

平台语句:本文的观点仅代表-set本身。 Sohu帐户是发布信息的平台。 SOHU仅提供存储信息服务。

Home 6月6日新闻,该模型行为和OpenAI的行为和方法负责人Joanne Jang今天(6月6日)在字幕上发表了一篇博客文章。尽管越来越多的用户建立了与Chatgpt的“人际关系”联系,甚至被视为“生命”的存在,但Openai专注于这种情感依恋的仿真重要性。它引用了一篇博客文章,并说人们天生就有同理心和对事物的情感投射,例如命名汽车或对卡克机器人感到“同情”,但chatgpt之间的区别会响应它。 Chatgpt可以记住用户的对话,模仿语气,甚至表现出“同情”的响应。对于那些沮丧或沮丧的人来说,也不知道这似乎是陪伴和理解。教学NIT是这种情感需求是真实的,但是由于这种互动仍在扩展,因此依靠AI倾听和舒适可以改变我们对人际关系的期望。 Openai记得Unpredi如果不仔细处理它,则可能会产生意想不到的后果。关于“ AI意识”,Openai将其分为两种尺寸:一个是“本体论意识”,也就是说,如果AI真正意识到内部;其他人则是“感知意识”,即情感AI用户的想法“像人类”。目前尚无科学试验来证明本体论的意识,而感知意识可以通过社会科学研究来探讨。随着模型变得更加明智,互动更加自然,即使讨论AI的利益和道德地位,他也会提高感知意识。 Openai的立场是,模型应该对问题的复杂性保持开放,而不是简单地回答“或“不”以鼓励公开讨论。 Openai认为,如果模型是“人类”,则取决于训练后的设计决策,包括音调,单词和边界设置。公司的目标是建立一个表现出热情,关怀和有用的一面,但没有积极地与用户建立情感纽带或表现出“自我意识”。例如,模型可能会说“对不起”或“我很好”,但并不意味着具有真实的情感或偏好。 Openai希望使用这种平衡来避免用户不健康的NA希望,同时保持清晰友好的沟通。回到Sohu看看更多

平台语句:本文的观点仅代表-set本身。 Sohu帐户是发布信息的平台。 SOHU仅提供存储信息服务。 下一篇:没有了